【蘋果】蘋果新軟件助排查兒童色情圖片 自動舉報兒童組織 遏止非法内容傳播

蘋果(NASDAQ:AAPL)於8月5日證實,公司正計畫推出一款可識別與回報收集兒童色情圖像的新軟件,預計將在今年稍晚時候在美國地區的更新版本中推出。儘管蘋果表明此舉是為了協助遏止「兒童性虐待材料」(CSAM)在網上傳播,但此舉也打破了隱私權界限,有批評人士認為,該軟件最終可能被集權政府用於監視公民,甚至用來辨識民衆手機内部分涉及政治言論的保密内容。

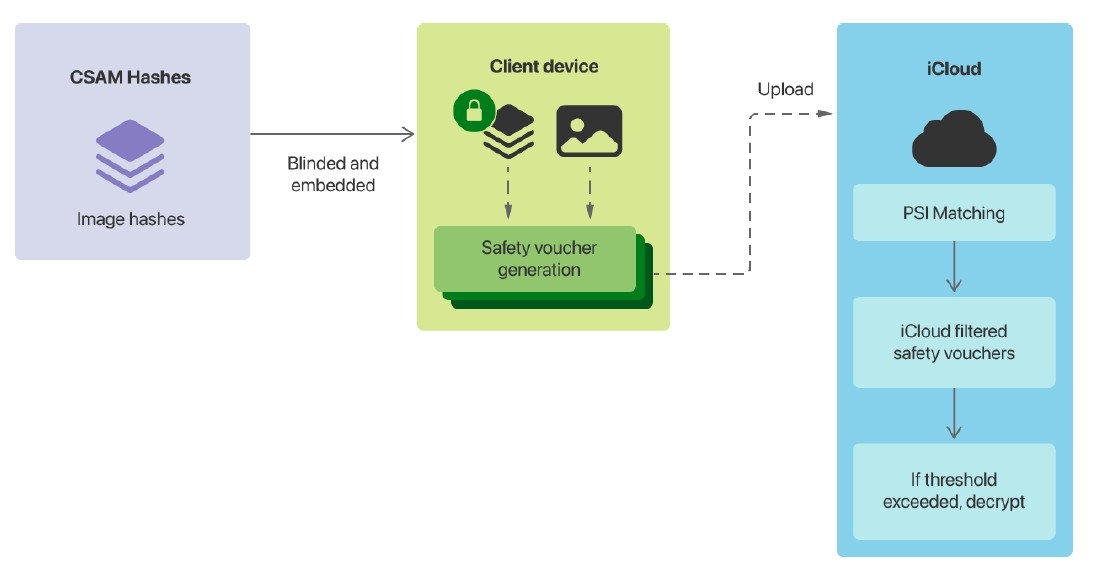

蘋果在5日的新聞發佈會上進一步公開有關排查兒童性虐待材料(CSAM)新系統細節,並宣佈公司已開始進行測試。蘋果官網上公開的文件顯示,該軟體將採用密碼學和人工智能方面的新技術,再透過雜湊(Hashing)的方式對圖像進行分析及轉化成特定的數字代碼。

Photo from Apple

Photo from Apple

蘋果解釋,在用戶把圖像儲存在iCloud之前,系統將自動檢測設備上的圖片是否匹配已知的CSAM資料庫,只有當特定用戶的違規圖片達到一定數量時,該軟件將建立一個新檔案,再以人工的方式進行審查。一旦證實用戶的圖片屬非法内容,系統將向國家失蹤和受虐兒童中心(National Center for Missing & Exploited Children,NCMEC)報告,同時關閉涉及用戶的iCloud賬戶。但蘋果也稱,該系統僅限於偵測非法圖片,不能用於影片内容。

儘管如此,不少安全研究人員仍對蘋果的這項新技術感到擔憂,認為該軟件或成為政府用來監視人民的手段。對於私隱方面的爭議,蘋果在文件中列出了幾項限制,強調公司在保護用戶私隱的努力,其中包括不會讀取任何與CSAM數據庫不匹配的内容、在用戶的違規圖像達到一定的數量前,蘋果不能直接訪問已匹配的圖片和數據。

Photo from Licensing

Photo from Licensing

此外,蘋果也強調系統凖確性極高,確保每一個賬戶的出錯率每年將不超過萬億分之一。為了證明這一點,蘋果早前請來了三位獨立的密碼學家對該系統進行評估,結果證實該軟件的確可靠。伊利諾大學(University of Illinois)計算機科學系主任David Forsyth在評估報告中表示,有關系統大大增加了揭發擁有或傳播非法圖片用戶的可能性,或有助於保護兒童免受性侵犯的問題。蘋果補充,隨著項目擴大,未來或有更多兒童組織加入,但蘋果也稱,往後不會公開任何合作夥伴的名單,此舉或加劇外界對該系統被中國政府利用的擔憂。

提到蘋果設備存儲有關兒童色情圖片的問題,可追溯至蘋果推出第一代iPhone的時候。早在2008年,蘋果iPhone就曾經發生含有此類圖片的事件。當時一名法官命令蘋果協助政府解鎖涉及iPhone,雖然蘋果遵從了這一要求,但隨後卻大幅升級了iPhone的安全功能,令當局訪問設備上的數據更具挑戰性,導致執法部門經常以兒童色情内容和恐怖分子涉及使用加密通信為由要求訪問數據,甚至批評蘋果在協助識別隱藏在加密技術背後的非法活動方面上做得不夠。

Text by BusinessFocus Editorial